皆様いかがお過ごしでしょうか。歌乃です。

3D modeling してますか?

大規模学習モデルで画像生成 (PromptGraphics) に傾倒している私ですが、PromptGraphics もモデルによって得手不得手があり、求める画像がなかなか生成されない、もしくは生成されているがいまいち納得がいかない、かゆいところに手が届かない状況も多く発生します。

そういった場合、納得のいかない部分を手描きしてしまうという手っ取り早い解決法があり、私も良くこの方法を使っています。

ですが、私の画力の低さもあって、求めるイメージが学習モデルになかなか伝わらない (学習モデルが手描き画像を元にしたノイズから求めるイメージを復元してくれる確率が低い) という自体が起こるわけです。

※いつものごとく大半が戯言です。

生成画像に不満がある

私の環境では、この現象は特にメカ類で発生します。

「もっと脚部は太いんだ!そんな細い脚で本体を支えられると思ってるのか! ( ゚Д゚)」

「その翼はいったいどこに繋がってるんだ!接合部を見せろ!( ゚Д゚)」

「なぜ綺麗な直線が出ないんだ!そんなガタガタでクリアランス取れると思ってんのか!( ゚Д゚)」

などなど。

今回は銃を持たせた画像を作りたかったのですが、どうにも気に入りません。

三枚目あたりを見ていた時に思いました。

「これなら (何百枚も生成ガチャするくらいなら) 自分の好きな銃をモデリングして取り込んだほうが早いんじゃね?( ゚Д゚)」

ないものは作ってしまえの精神

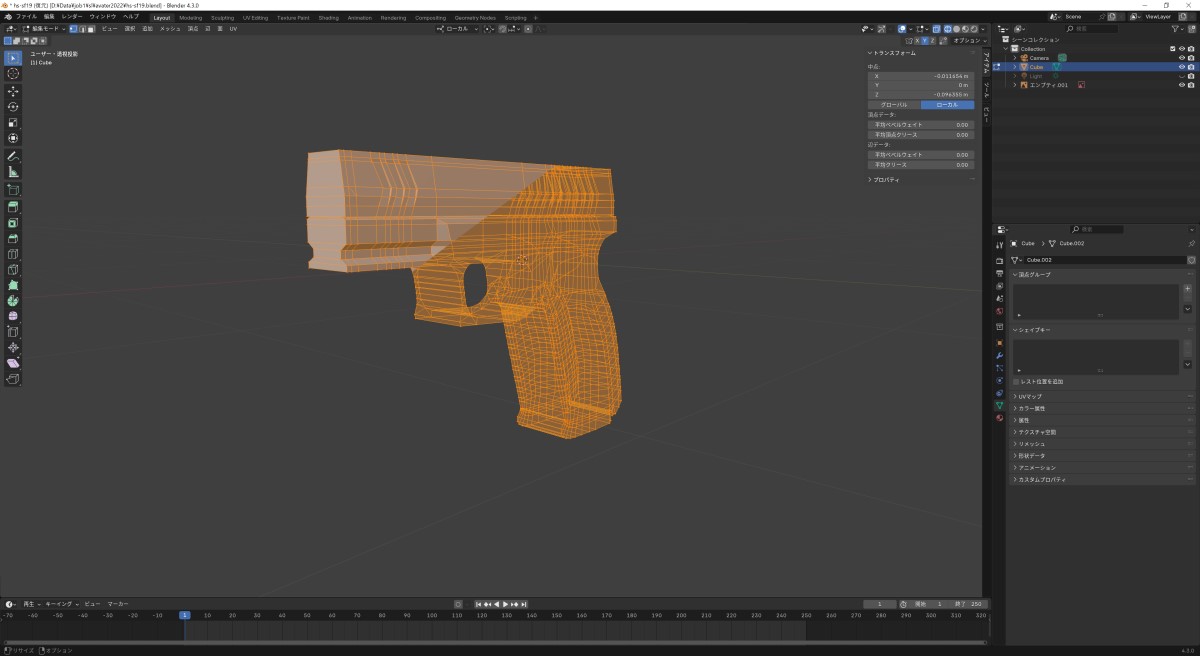

ということで、さっそく blender でお気に入りの銃をモデリングしました。

そう、SCUM で毎回お世話になっている頼もしいサブウェポン「HS-SF19」です。

HS-SF19 はクロアチアの HSproducts が製造元の半自動拳銃です。9mm パラベラムならマガジン装弾数19発、チャンバー内を含めると 20発を装弾可能で集団戦での面制圧や、撃ち合いでの弾数/リロードの優位性など、9mmならとりあえずこれ選んどけ、な優良銃です。

系譜であるHS2000シリーズはクロアチアで軍や警察で採用されており、銃大国アメリカではスプリングフィールドXDとしてバリエーションが販売されています。

HS-SFシリーズは、グリップセーフティや、トリガーセフティーなど不意の暴発を防ぐ安全装置が盛りだくさんで、そういった点も公的機関で採用されるポイントになっていると思われます。グリップを自分の持ちやすいようにカスタマイズできるという点と、特徴的な「くの字」のセレーション(スライド上に刻まれた滑り止め用の溝)がおしゃれで個人的にポイントが高いです。

私の HS-SF19 愛は脇に置いておくとして、とりあえずモデリング開始。

いつものようにローポリでテクスチャ張ろうとして、早々に挫折。

画像素材のためにモデリングしてるのに、そのモデリングのためにテクスチャ画像を作らないといけないという理不尽 ( ゚Д゚)

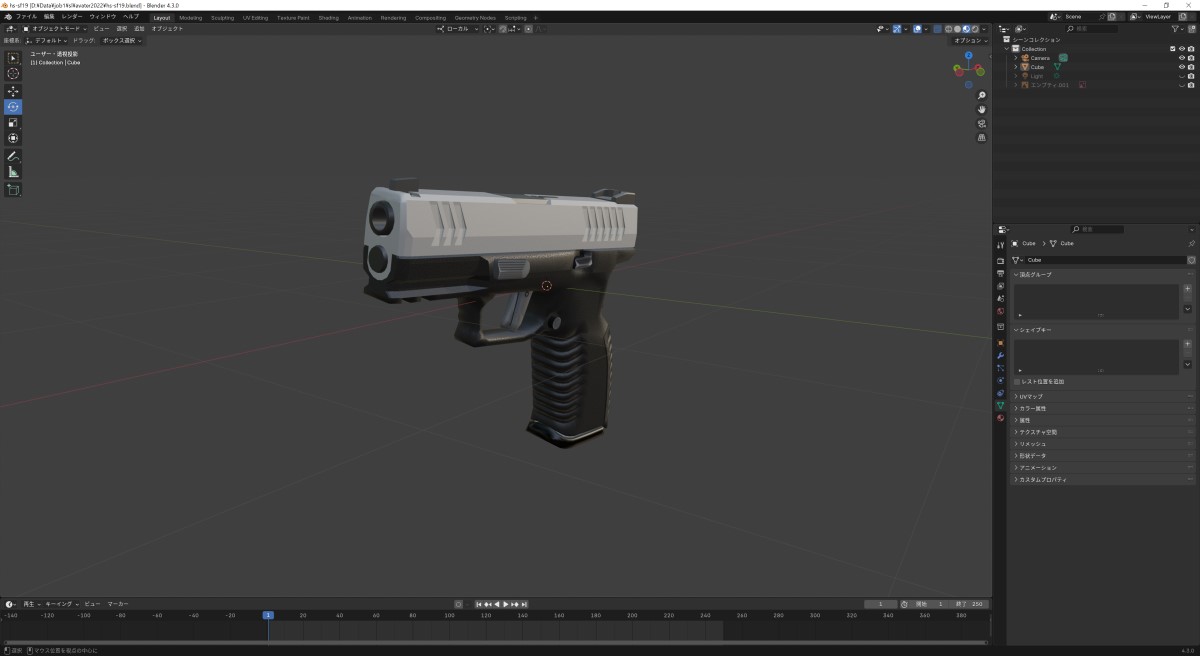

なのでハードサーフェスなモデリングに方向転換。

本来はブーリアンモディファイアなんかを使って形状を作っていくのだけど、私にはまだそのスキルが無い。

ので、地道に頂点編集で形を作っていきます (太古の技術 & 力技)。

かなり中途半端な出来なのだけど、その理由は後述。

とりあえず、ぱっと見で「HS-SF19 っぽいな」とわかるので良しとしよう。

実際に画像生成に取り込んでみた。

やりかたはいたって簡単。

3Dモデルのスナップショットを Clip Studio Paint で基本画像に合成 (安定の力技)。

できあがった画像をもとに i2i (image to image) で画像生成。

そうしてできたのが以下の画像。

人物、銃はいいけど指が。  銃のディティールが。

銃のディティールが。  うーん。この辺で妥協するか。

うーん。この辺で妥協するか。

#これを見た人は我に続いて銃を握れ

— utano (@UtanoSchell) November 26, 2024

PromptGraphics SD35L https://t.co/rQKcGlmWgi pic.twitter.com/khfgZyrqC0

結局三枚目を選んだわけですが、かなり妥協と言うか、頑張ってモデリングしても生成過程でディティールは反映されないことが分かった (モデルが学習した銃のディティールに置き換えられると予想、モデリングの作り込みを止めた一因) ので今回はあきらめた感じです。

結論的に

モデリングによる小物の取り込み自体は悪くないアイデアなのですが、結局ところ (当たり前ですが) 生成結果にはモデルの学習したデータ内にあるディティールしか再現できないようです。

ということで本格的に HS-SF19 を画像生成させたいならモデルに学習させるしかないという結論に至りました。

学習させずにディティールまで再現するなら、3Dモデルのスナップを合成して i2i でディティールに影響のでない範囲の image scale 強度で生成するしかありません。

その場合、せっかくの学習モデルの「学習」部分が生かされず、単なる画像加工フィルターになってしまいます。

今回の i2i 生成画像でも腕と銃、あるいは視線と銃の、消失点が一致しておらず、よくみると不自然さが見立ちます。

本来であれば学習モデル側が構図や消失点から伸びる線上に画像を配置してくれる (事を期待している) のですが、ディティールを生かすために image scale 強度を抑えているせいで元画像の構図の不自然さがそのまま引き継がれてしまっています。

元画像の合成時に構図もしっかりと意識してやればイケるかもしれませんが、専用のソフトウェアでもない限り手作業では厳しいです。

自分の趣味全開で始めた今回のモデリング&画像生成でしたが、結果は微妙でいたが、いろいろと気付きが多く、有意義な試行作業でした (`・ω・´)